19 April 2026 –

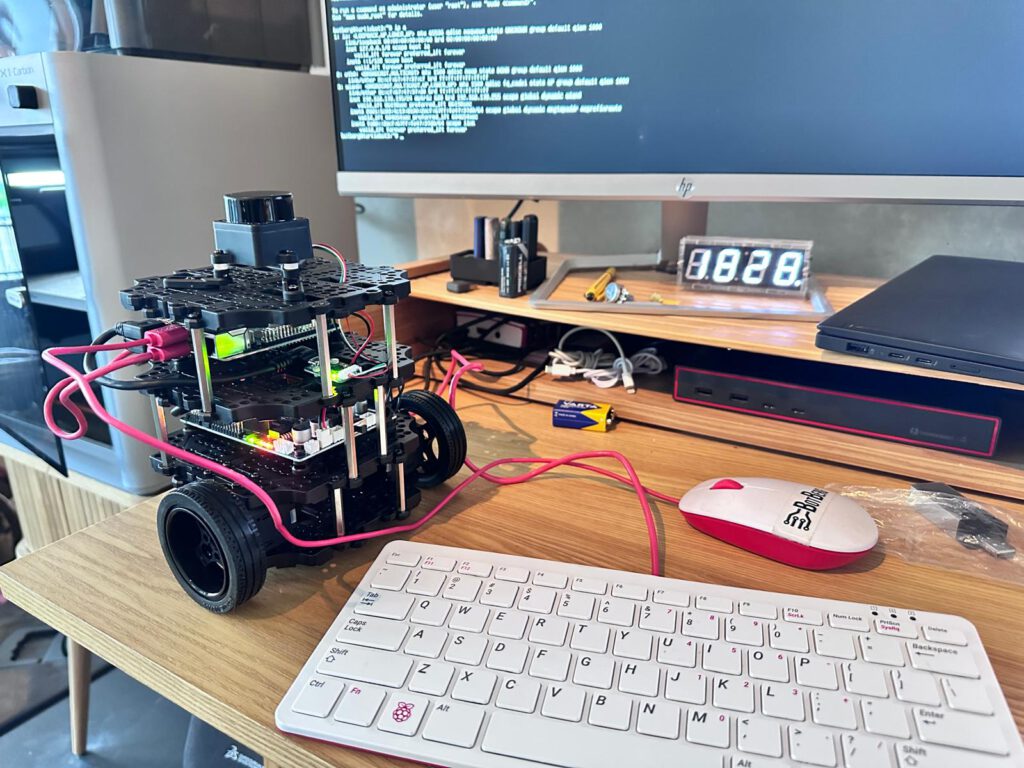

De doos staat op de werkbank. ROBOTIS-logo, ROS-badge, Burger in grote letters. Tien minuten later liggen alle onderdelen uitgestald en begint de opbouw. Doel: een volledig werkend ROS2-platform dat ik kan inzetten voor workshops, demonstraties en onderzoek in autonome navigatie.

De hardware

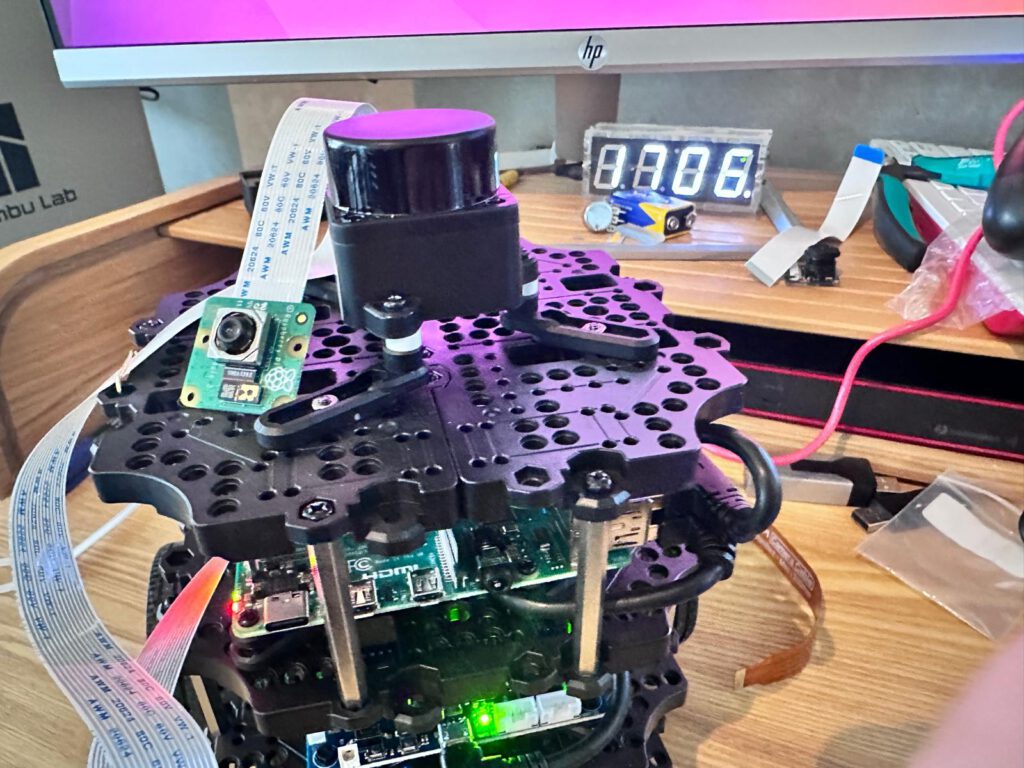

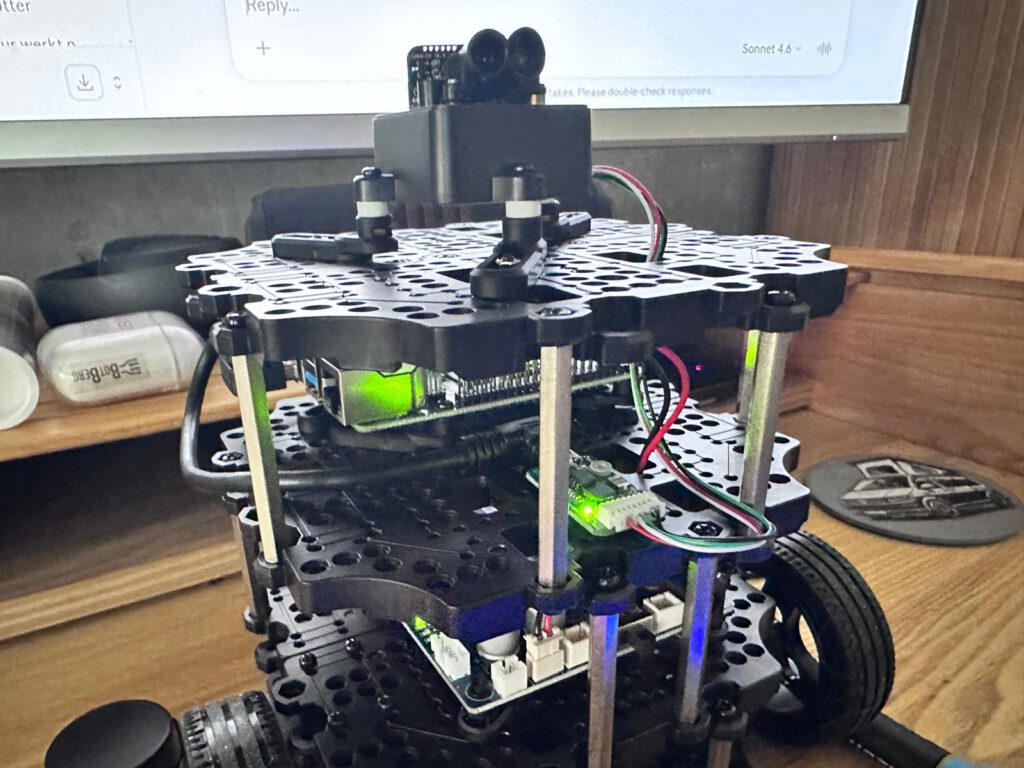

De TurtleBot3 Burger is het kleinste platform in de TurtleBot3-familie — een compact drielaags stapelframe op twee Dynamixel XL430-W250 servo-motoren. Geen gewone servo’s: ze communiceren via een seriële TTL-bus, geven positie, snelheid en temperatuur terug, en zijn individueel adresseerbaar via een uniek ID op dezelfde kabel. Precies wat je wil voor een educatief platform — je ziet altijd exact wat de robot doet.

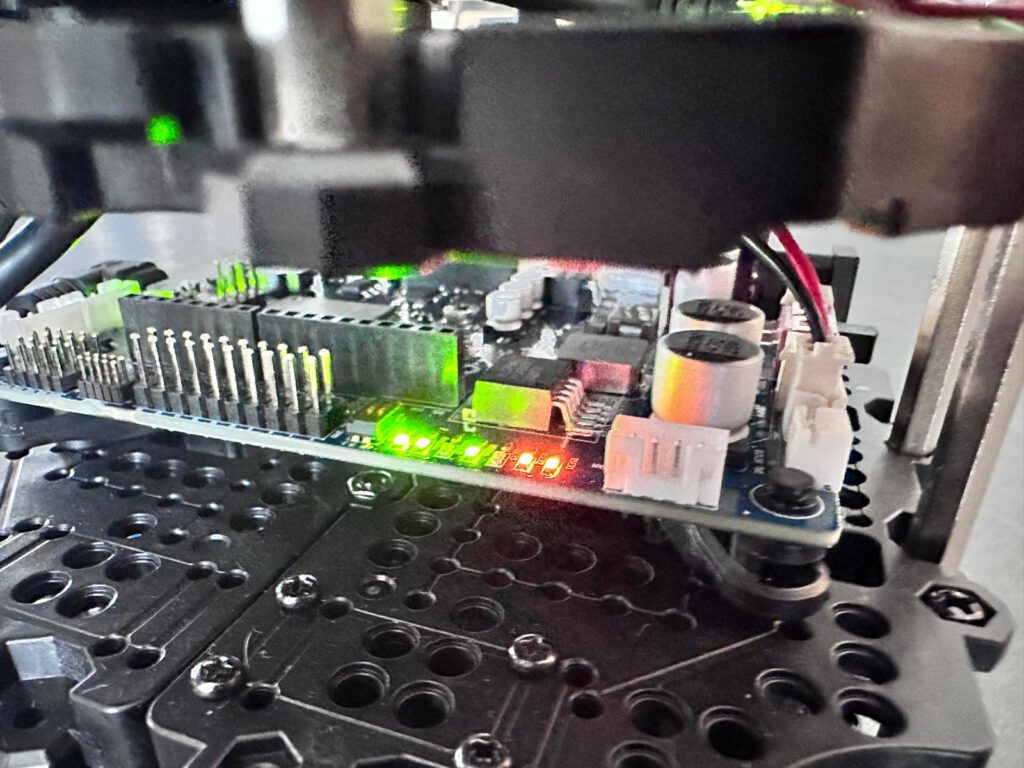

Onderaan zit het OpenCR 1.0-board. Dat is de motorcontroller die de Dynamixels aanstuurt en tegelijk als brug fungeert tussen de Raspberry Pi en de hardware. Daarboven de Raspberry Pi 4B met 4GB RAM — verbonden via USB met de OpenCR en de LiDAR.

De opbouw

De doos bevat vier kleinere doosjes — elk onderdeel netjes gesorteerd en verpakt. De bouwkwaliteit is uitstekend: strakke toleranties, degelijke connectoren, geen spelende onderdelen. Het monteren van het frame, het plaatsen van de Dynamixels, het aansluiten van de OpenCR en het bevestigen van de Raspberry Pi is een kwestie van de manual volgen. En die manual is goed — helder, stap voor stap, met aparte secties voor mechanisch, elektrisch en software. De meest actuele versie is niet in de doos gedrukt maar online beschikbaar, toegankelijk via de QR-code op de verpakking. Slimme keuze: zo zijn updates direct beschikbaar zonder nieuwe drukken.

De volledige opbouw heb ik vastgelegd in een timelapse — één frame per drie seconden, totale looptijd 1:13. Dat geeft een aardig beeld van het tempo: niet gehaast, gewoon methodisch de stappen doorlopen. Geen gereedschap, geen soldeerwerk, geen speciale kennis vereist. Wie de manual volgt bouwt een rijdende robot.

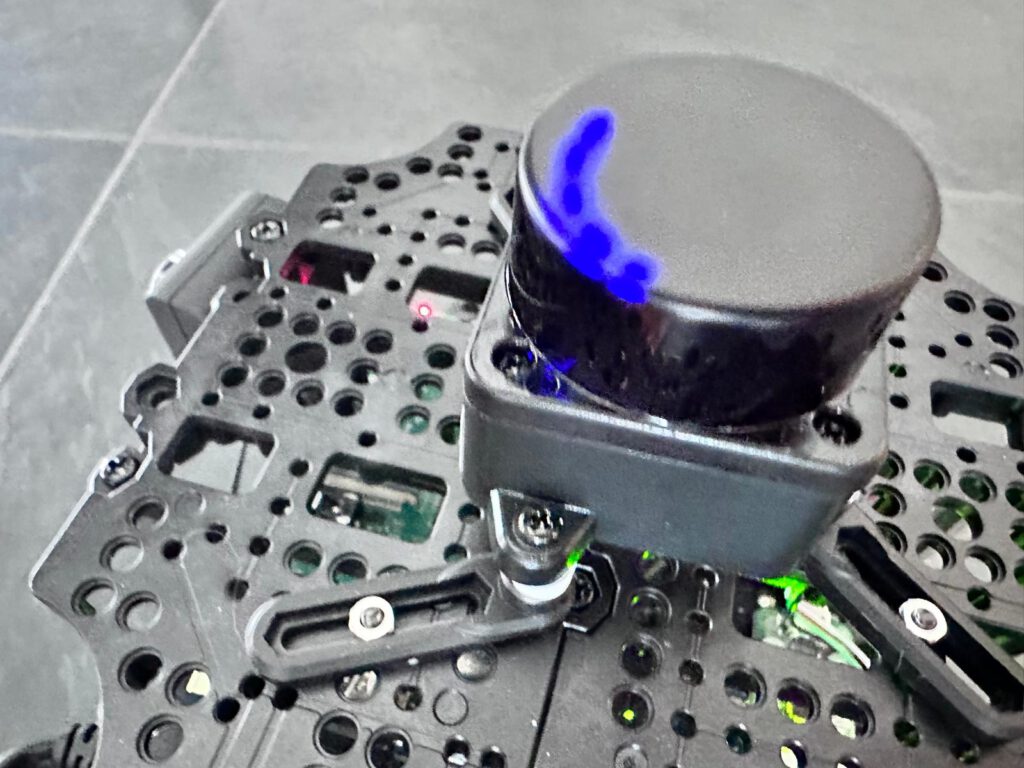

Bovenop de stapel zit de LDS-03 LiDAR van ROBOTIS. Dit is een recent exemplaar — ROBOTIS heeft de sensor gewisseld vanaf oktober 2025. De LDS-02 is discontinued en vervangen door de LDS-03, waarbij het externe motortje is komen te vervallen. Dat heeft voordelen voor het onderhoud — geen slijtende mechanische onderdelen, geen losse connector die trillingen oplevert — maar het maakt validatie tijdens de opbouw wat lastiger. Bij de LDS-02 zag je meteen of de sensor draaide. Bij de LDS-03 is dat visueel minder evident. Gelukkig zit er bovenin de behuizing een blauw ledje dat direct verbonden is aan de interne draaimechaniek. Brandt het ledje? Dan draait de LiDAR. Dat is het enige signaal dat je krijgt — en het is genoeg.

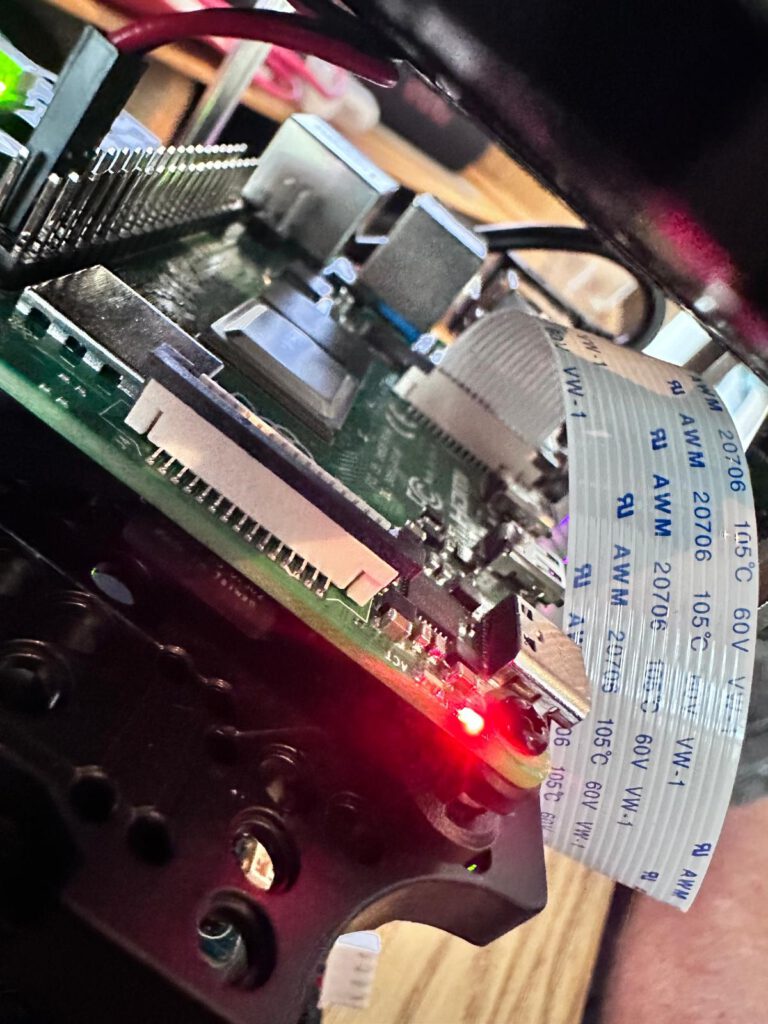

Tijdens de sessie voeg ik ook een USB HD-camera toe voor een live camerastream, en probeer ik een Raspberry Pi Camera Module 3 aan te sluiten via de CSI-poort. Die laatste vraagt wat meer geduld — de flatcable heeft een specifieke richting en hot-swappen terwijl de Pi aan staat is een slecht idee. Dat laatste doe ik toch. Eenmalig.

De software-stack

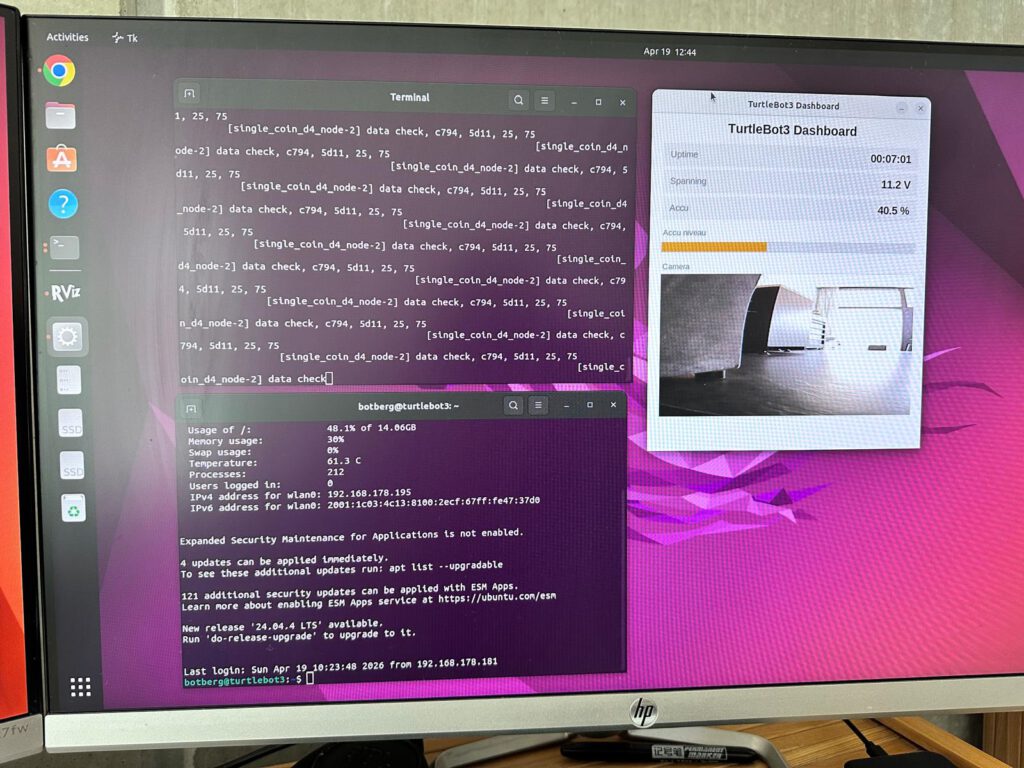

De Raspberry Pi 4B krijgt Ubuntu 22.04 Server via Raspberry Pi Imager, headless geconfigureerd met wifi-credentials en SSH. ROS2 Humble gaat er handmatig op via de officiële repositories. De ThinkPad T490s krijgt een dual-boot Ubuntu 22.04 naast de bestaande Ubuntu 20.04 installatie. Beide draaien Humble, hetzelfde ROS_DOMAIN_ID=30, en dezelfde RMW-implementatie — rmw_fastrtps_cpp. Zo vinden Pi en laptop elkaar op het netwerk zonder extra configuratie.

De OpenCR-firmware flash ik via de T490s. Het meegeleverde flash-script kan niet overweg met de aarch64-architectuur van de Pi 4B, dus de x86-binary op de laptop doet het werk. Één commando, twee minuten, jump_to_fw in de terminal — klaar.

Probleemoplossing: de LiDAR

De eerste bringup faalt met een KeyError: 'LDS_MODEL'. De juiste instelling is LDS_MODEL=LDS-03, en de bijbehorende driver is coin_d4_driver — te installeren als ros-humble-coin-d4-driver. Na het aanpassen van de environment-variabelen en een herstart: data op stabiele 10 Hz.

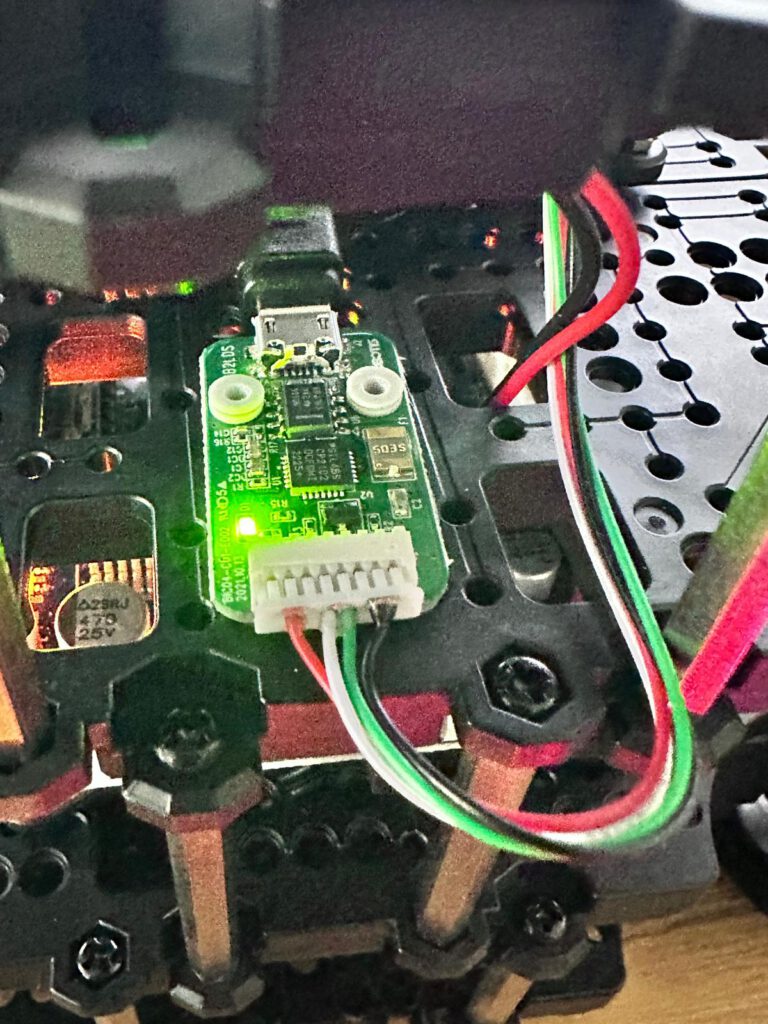

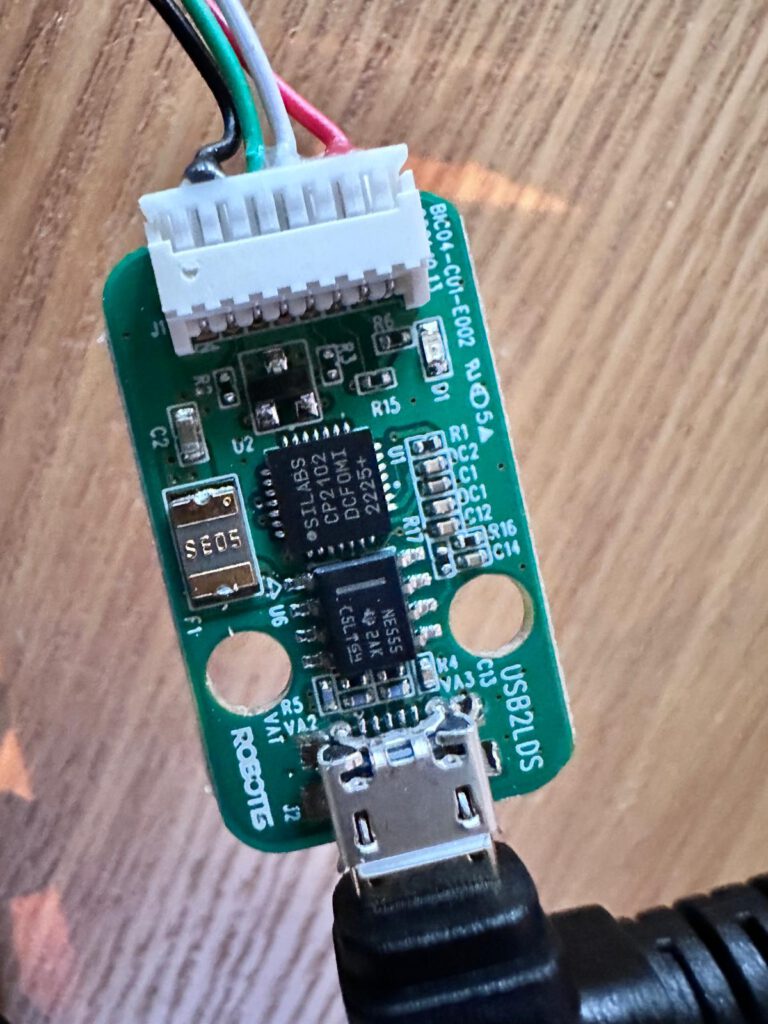

Het USB2LDS-bordje — een kleine ROBOTIS PCB met een Silicon Labs CP2102 USB-UART bridge — vormt de interface tussen LiDAR en Pi. Micro-USB naar de Pi, JST-connector naar de LiDAR. Geen draaiend motortje om op te wachten. Gewoon een blauw ledje en data op het /scan-topic.

De opstelling

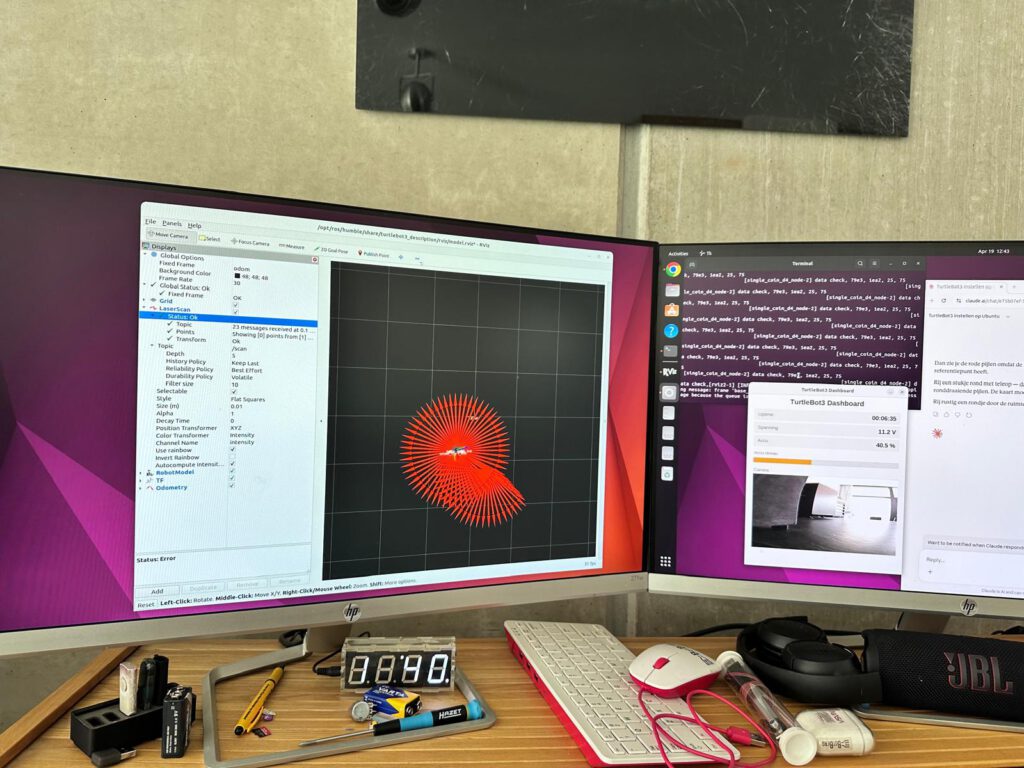

Op de T490s draait RViz2 — de LiDAR-scan als rode puntenwolk rondom de robotrepresentatie. Naast RViz2 een zelfgebouwd Tkinter dashboard in Python: live camerastream van de USB-webcam, accuspanning op één decimaal, accupercentage met kleurgecodeerde balk, en een uptime-teller. Alles via ROS2-topics.

Besturing gaat via toetsenbord of via een PS4 DualShock V2 controller draadloos op Bluetooth — aangestuurd via joy_node en teleop_twist_joy. Met require_enable_button:=true reageert de controller alleen als L1 ingedrukt is. Zo voorkom je dat joystick-drift de robot ongewenst in beweging zet.

Eén opstartscript — start_all.sh — start via SSH de Pi-stack op afstand, wacht op initialisatie, en brengt daarna RViz2, het dashboard, de joy-node en teleop omhoog. Eén commando, alles draait.

Eerste stappen en autonome navigatie

Met de robot rijdend en de LiDAR actief beginnen de eerste echte tests. Via Cartographer bouwt de TurtleBot3 al rijdend een ruwe 2D-plattegrond van de kamer op. De LiDAR-data wordt vertaald naar een occupancy grid — vrije ruimte, muren, obstakels. Elke ronde die de robot rijdt maakt de kaart completer.

Zodra de kaart bruikbaar is neemt Nav2 het over. In RViz2 zet ik een waypoint op de kaart, en de TurtleBot3 gaat zelfstandig op pad. Nav2 berekent een route en de robot rijdt — zonder verdere sturingsinput.

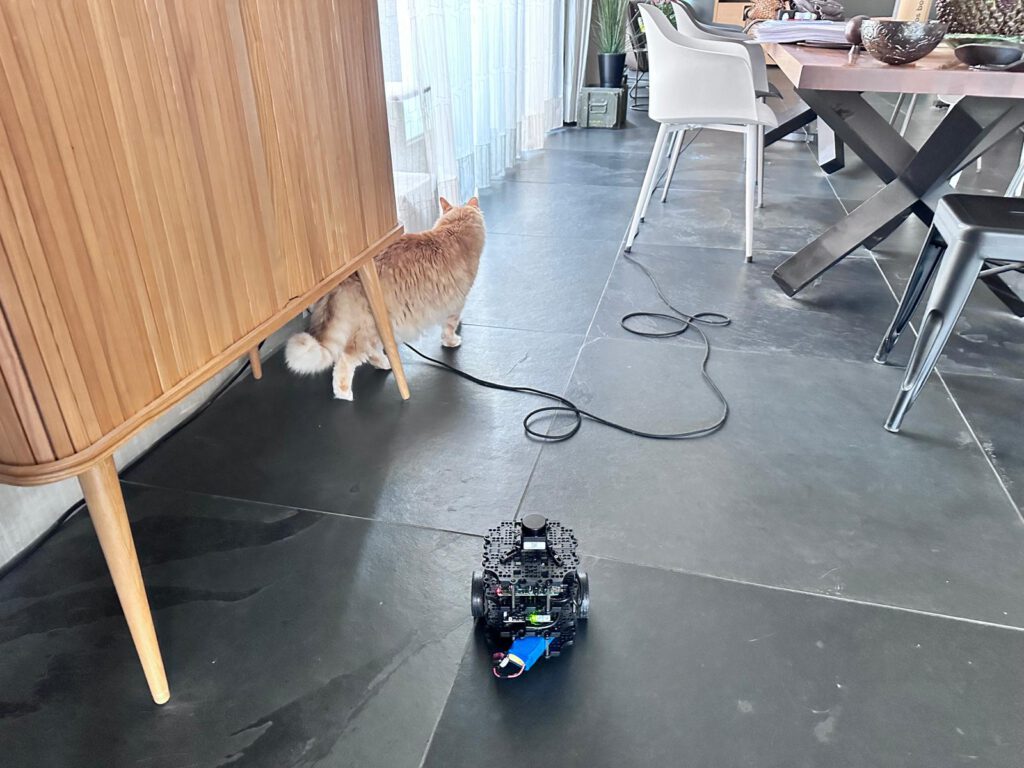

Het pad is niet statisch. Ga ik voor de robot staan, dan detecteert de LiDAR mij als obstakel en past Nav2 de route in real time aan. De robot wijkt uit, zoekt een alternatief, en vervolgt zijn weg. Dynamische padplanning op basis van live sensordata — de basis van autonoom rijden in de praktijk.

De beperkingen zijn ook direct zichtbaar. De LiDAR ziet alles op één hoogte — er is geen onderscheid tussen een mens, een stoel of een doos. Alles wat in de weg staat is een obstakel, maar wat het is weet de robot niet. Daarnaast is er geen hoogtebewustzijn: gaten in de vloer, drempelstenen of verhoogde platforms zijn voor de sensor onzichtbaar. De robot navigeert in een plat, tweedimensionaal model van de wereld. Een bewuste beperking van dit platform — en een directe aanleiding voor de volgende stap: een dieptecamera voor 3D-perceptie.

De kwaliteitscontrole

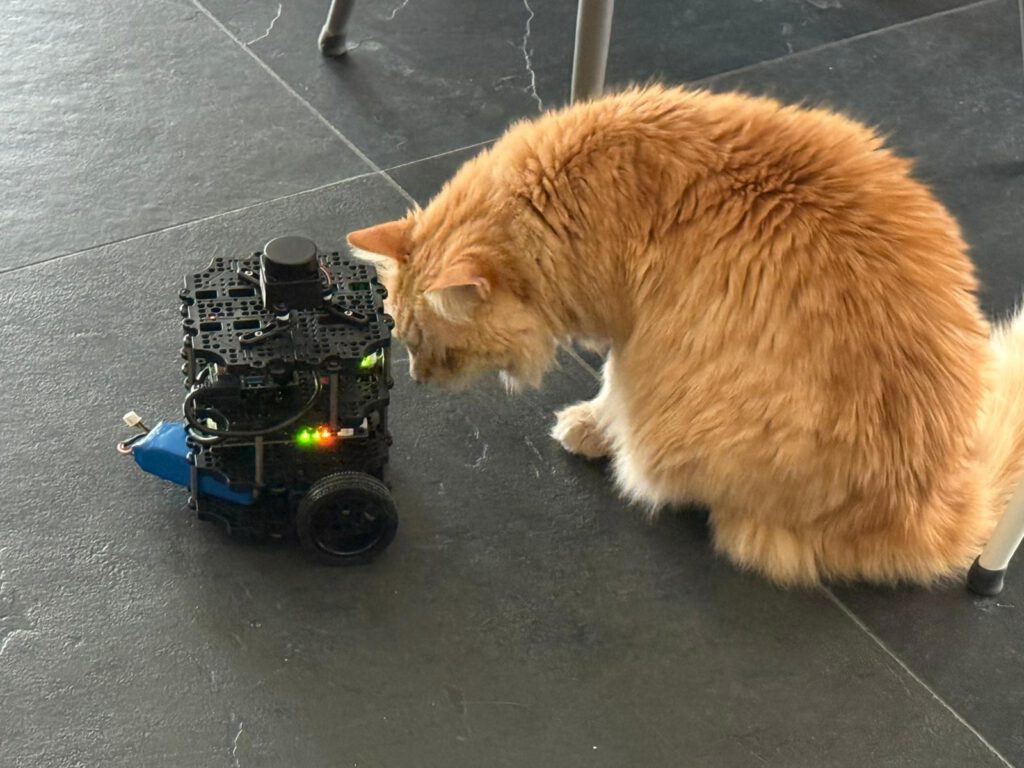

De robot rijdt. De LiDAR scant. De camera streamt. Cartographer bouwt de kaart. Nav2 stuurt de robot naar zijn doel. En dan verschijnt de kat — neust aan het platform, loopt er een rondje omheen, en trekt zich terug onder de kast. Voor de TurtleBot3 is hij gewoon een obstakel. Voor mij is het de bevestiging dat alles werkt.

Gebruikte hardware

TurtleBot3 Burger (ROBOTIS) met Raspberry Pi 4B 4GB

– OpenCR 1.0 motorcontroller

– LDS-03 LiDAR met USB2LDS-interface

– Lenovo ThinkPad T490s (Ubuntu 22.04, ROS2 Humble)

– USB HD-camera

– Raspberry Pi Camera Module 3 (in progress)

– PS4 DualShock V2 controller

Gebruikte software

– Ubuntu 22.04 LTS

– ROS2 Humble

– ros-humble-turtlebot3, ros-humble-coin-d4-driver, ros-humble-ld08-driver

– ros-humble-turtlebot3-cartographer, ros-humble-navigation2

– ros-humble-joy, ros-humble-teleop-twist-joy

– ros-humble-v4l2-camera

– Python 3 / Tkinter dashboard

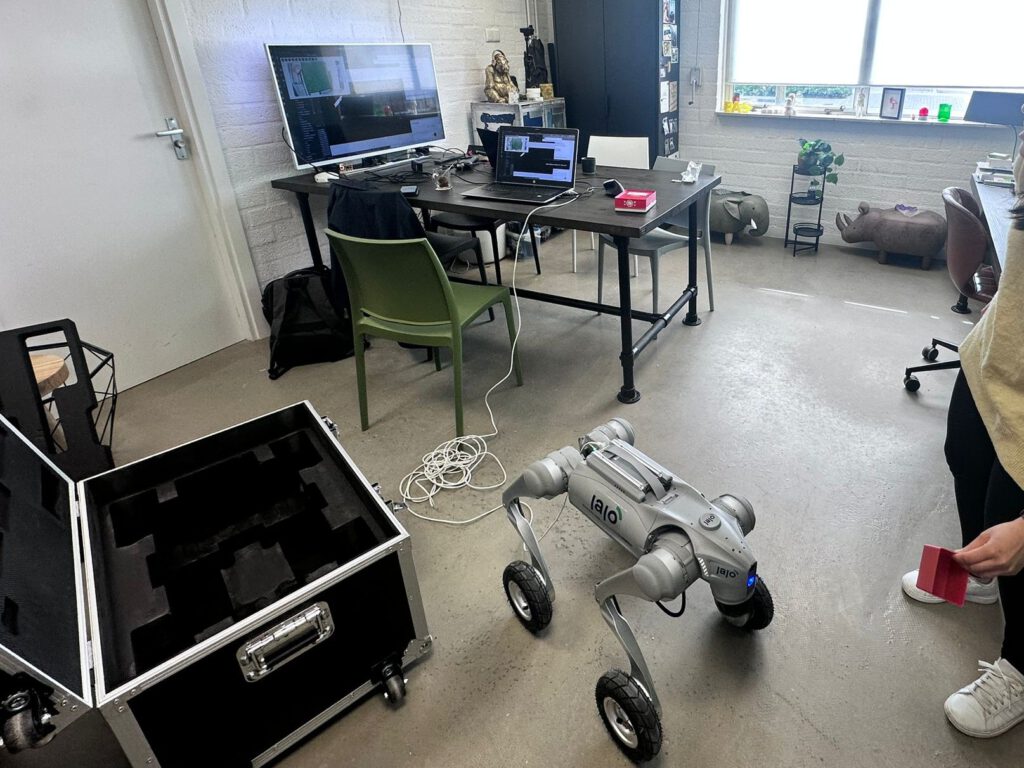

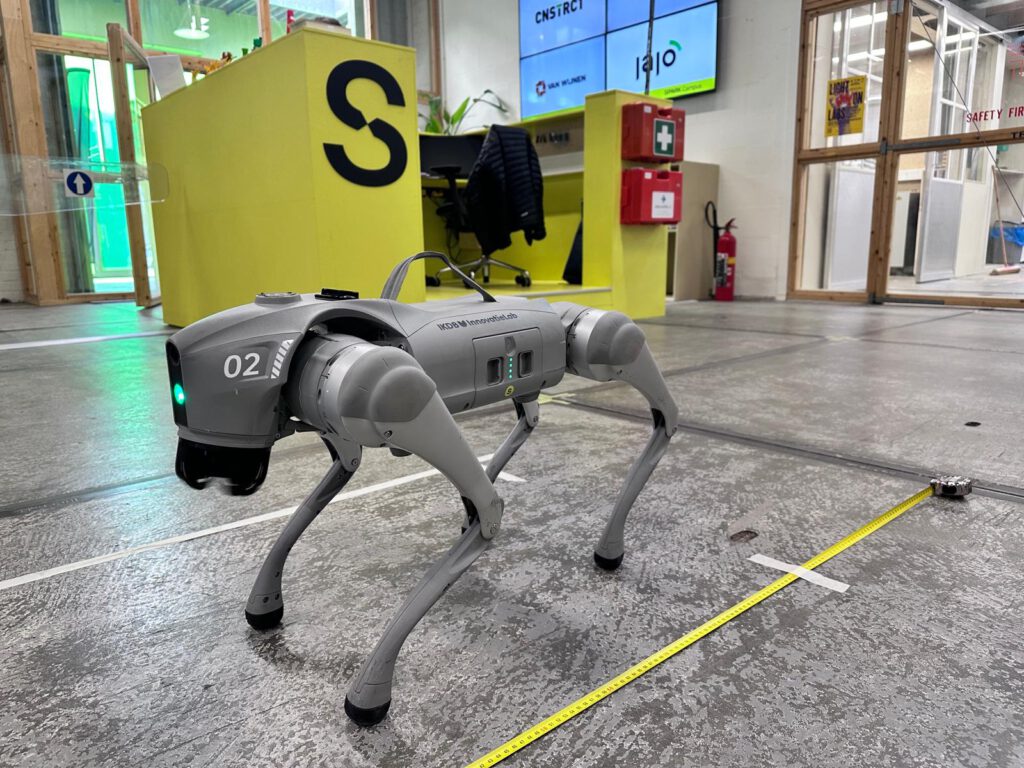

Van testbank naar inspectiehond

De TurtleBot3 is daarmee niet alleen een speeltje of leermiddel — hij is een directe voorloper van wat ik in de praktijk inzet. Via BotBerg ben ik actief betrokken bij de ontwikkeling van een geautomatiseerde inspectieoplossing voor nieuwbouw, samen met JaJo en SPARK Campus. JaJo zet daarvoor KAI in — een autonome inspectiehond op basis van de Unitree Go2W — en de SPARK Campus werkt met Sparky, een Go2 die ingezet wordt voor educatieve en onderzoeksdoeleinden.

De uitdagingen zijn groter, de hardware is zwaarder, maar de onderliggende technologie is dezelfde: ROS2, Nav2, LiDAR, SLAM, autonome padplanning. Wat ik op de TurtleBot3 uitwerk en valideer — navigatielogica, sensorintegratie, dashboards, opstartworkflows — voedt direct de ontwikkeling van die grotere systemen. De Burger is de testbank. KAI en Sparky zijn de eindbestemming.

Kom het zelf zien

Wil je zelf aan de slag met robots en autonome navigatie? SPARK Campus organiseert de workshop Physical AI in de Praktijk — werken met robots, waarbij je hands-on kennismaakt met precies deze technologie.

Een eerste voorproefje is al snel: komende week ben ik aanwezig bij de HAS Geo Experience, waar ik tijdens de Netwerkmarkt en demozone een live demonstratie geef van wat Physical AI in de praktijk betekent — robots die zelfstandig navigeren, mappen en beslissingen nemen. Kom langs als je meer wil zien dan alleen foto’s.